据最新研究显示,北京大学集成电路学院孙广宇团队在面向边缘侧大语言模型(LLM)推理加速的DRAM近存计算架构领域取得重大突破。团队基于混合键合工艺,设计出名为H2-LLM的全新架构,成功解决了传统DRAM近存计算在边缘设备上算力受限的问题。该架构通过提出通用近存计算模板和“以数据为中心”的数据流抽象,结合设计空间探索框架,实现了2.72倍的性能提升和1.48倍的能效提升。

大语言模型作为人工智能领域的关键技术突破,凭借强大的语言理解与生成能力,在问题推理、聊天助手、代码补全等任务中表现出色。然而,如何在边缘设备上实现高效的大语言模型推理,满足用户对数据隐私和个性化需求,同时提供流畅体验,仍是当前亟待解决的重要课题。

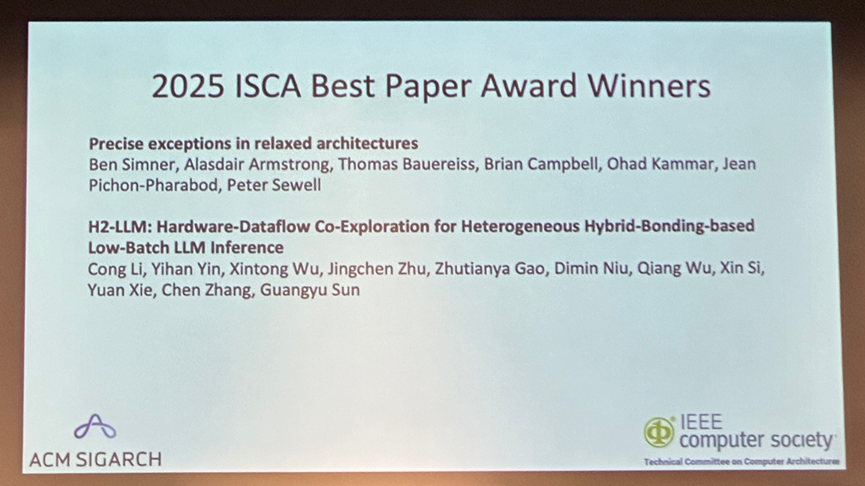

这项研究成果由北京大学与上海交通大学、东南大学、后摩智能及阿里巴巴达摩院联合完成,发表在第52届计算机体系结构国际研讨会(ISCA)上,并获得最佳论文奖。这是国内学术机构首次在ISCA获此殊荣。